Miért van óriási igény Python fejlesztőkre – A legfontosabb trendek bemutatása

Ismerd meg, mi hajtja a Python fejlesztők iránti növekvő keresletet: az iparágak sokszínű elvárásai, a nyelv sokoldalú felhasználási lehetőségei és azok a folyamatosan alakuló technológiai irányok, amelyek formálják a karrierlehetőségeket.

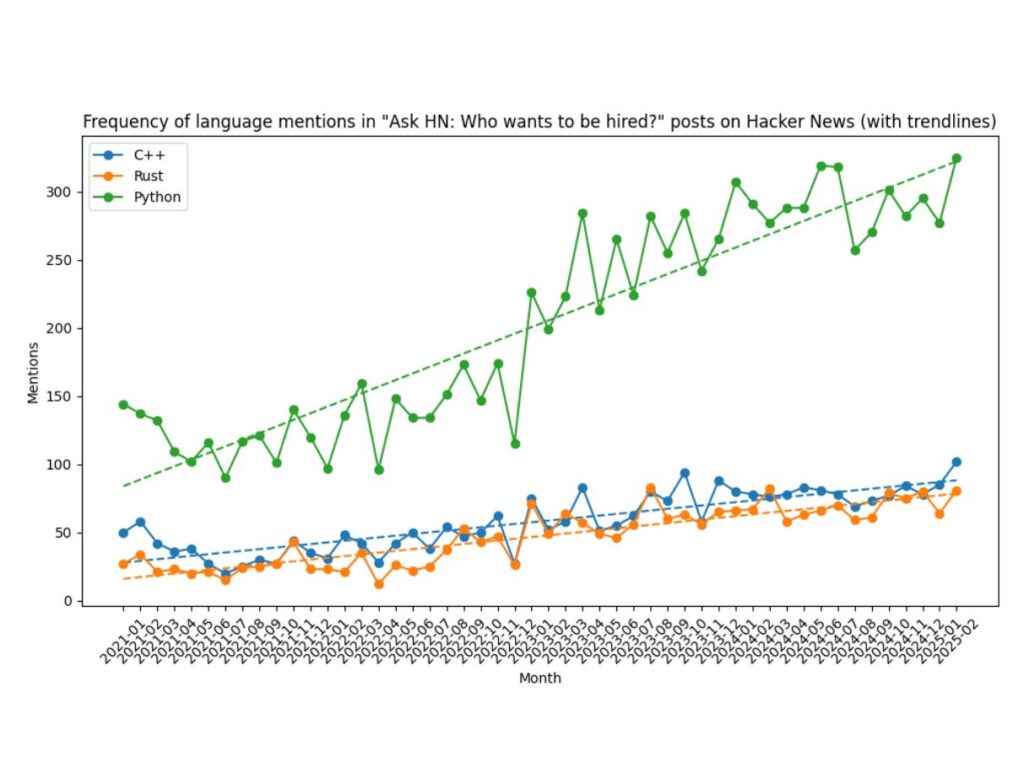

Ha éppen azon töröd a fejed, merre érdemes irányítani programozói karrieredet, a Pythonra való specializálódás most különösen jó befektetés. A 2025-ös Stack Overflow fejlesztői felmérés szerint a nyelv stabilan ott van a három legkeresettebb között, a válaszadók 31%-a említette, hogy új munkahelyén aktívan használja. Ez nem a véletlen műve: valós piaci igényeket és iparági változásokat tükröz, hiszen a Python sokoldalúsága kézzelfogható előnyt jelent a különböző projektek sikerében.

Vajon a cégek valóban tudatosan választják a Pythont, vagy csak követik a legújabb trendet? A válasz a kézzelfogható üzleti eredményekben rejlik. A hatékonyság növelése ma kulcsfontosságú, és ebben a Python kulcsszerepet játszik: az automatizálási keretrendszerek, az adatelemzési folyamatok és a skálázható backend megoldások mind erősen támaszkodnak a nyelv gazdag eszköztárára. A pénzügyi szolgáltatások területén például két év alatt 45%-kal nőtt a Python alkalmazása, elsősorban az algoritmikus kereskedési rendszerek és a kockázatmodellezési megoldások fejlődésének köszönhetően. Ezzel párhuzamosan az ilyen készségeket igénylő álláshirdetések száma több mint 60%-kal emelkedett a munkaerőpiacon.

Felmerülhet az a kérdés is, hogy ez a trend nem éri-e el hamarosan a telítettségét, csökkentve a karrierlehetőségeket? A valóság azonban azt mutatja, hogy a mesterséges intelligencia, a gépi tanulás és a felhőalapú alkalmazások folyamatos bővülése tovább növeli a Python szerepét. A mikroszolgáltatások irányába mozduló vállalatok egyre gyakrabban választják a Pythont karbantarthatósága és integrációs képességei miatt, gyakran konténerekkel és irányítási technológiákkal, például Kubernetes-szel kombinálva. Ez a többszintű igény rétegezett szakértelmet kíván, jutalmazva azokat, akik képesek az összekapcsolt ökoszisztémákban fejleszteni tudásukat.

És mi a helyzet az újonnan érkezőkkel, akik szeretnének betörni a szakmába? Az aszinkron programozás, a Pandas és NumPy adatfeldolgozó könyvtárak, valamint a Django vagy FastAPI webes keretrendszerek ismerete komoly előnyt jelent. A kódolási képességek és a szakterületi tudás – például fintech, biotechnológia vagy média – kombinációja tovább növeli a foglalkoztathatóságot. A LinkedIn toborzási statisztikái szerint az ilyen, több területen jártas jelöltek 3,5-szer nagyobb eséllyel kapnak állásinterjúra való meghívást, mint azok, akik csupán az alap programozási profilra támaszkodnak.

Röviden, ha időt szánunk egy olyan portfólió felépítésére, amely valós projekteket mutat be és rugalmasan alkalmazkodik az újonnan megjelenő területekhez, jelentős előnyre tehetünk szert. A piac iránti kereslet nem csökken; éppen ellenkezőleg, növekszik, és azokat jutalmazza, akik képesek mélységben és szélességben is eligazodni ebben a folyamatosan bővülő ökoszisztémában.

Az adatelemzés és az adattudomány térhódítása

Az adattudomány és az adatanalitika kulcsszereplővé vált a modern üzleti döntéshozatalban. A NewVantage Partners 2025-ös Big Data és mesterséges intelligencia vezetői felmérése szerint a vállalatok 92%-a bővítette befektetéseit adatkezdeményezésekbe, ami folyamatosan növeli a szakértők iránti keresletet ezen a területen. Ez a trend kiemeli azokat a szakembereket, akik jártasak a hatalmas adathalmazok feldolgozásában és értelmezésében – és akik képességei tökéletesen illeszkednek a sokoldalú, egyszerű és gazdag könyvtárakkal rendelkező programozási nyelvekhez, mint amilyen a Python is.

Mi különbözteti meg a mai adattudományi és analitikai szerepköröket? Több tényező együttes hatása: a strukturálatlan adatok robbanásszerű növekedése, a gépi tanulási modellek folyamatos fejlődése, valamint a gyakorlati, üzleti szempontból is értékes információk iránti kritikus kereslet, amelyek közvetlenül hozzájárulnak a jövedelmezőség növeléséhez. Az IBM adatai szerint az Észak-Amerikában elérhető adatközpontú állások száma 2025 év végére 2,7 millióról több mint 3,5 millióra nő, jelezve a piac dinamikus bővülését.

Egy praktikus tipp: a statisztikai elemzésre specializált Python-könyvtárak, mint a pandas, a NumPy és a scikit-learn elsajátítása drámaian felgyorsíthatja a valós projekten való munkálatokat. Ezek az eszközök leegyszerűsítik az adatkészletek tisztítását, az adatok előkészítését, valamint a prediktív modellek felépítését, amelyek kihatnak az ügyfélszegmentálástól kezdve az ellátási lánc optimalizálásáig minden területre.

Vegyük például az egészségügy, a pénzügy és a kiskereskedelem területeit. Az adatvezérelt stratégiák elterjedtsége ezeken a szektorokon lenyűgöző. A Deloitte 2025-ös egészségügyi elemzési felmérése szerint például a szolgáltatók 78%-a már aktívan alkalmaz adatelemzést a betegek újbóli felvételi arányának csökkentésére, az ellátás minőségének javítására és milliók megtakarítására.

Lehet, hogy felmerül benned a kérdés: „Megéri-e adatelemzésre specializálódni a folyamatosan változó algoritmusok és módszerek közepette?” A válasz az alkalmazkodóképességben rejlik. Ha az alapvető statisztikai fogalmakat a gyakorlati kódolási készségekkel ötvözöd, könnyen át tudsz állni az új módszerekre és technológiákra. Ez a kombináció egy hosszú távon értékes és sokoldalú készségkészletet biztosít.

A gyakorlati tudás elmélyítéséhez érdemes nyílt adathalmazokkal kísérletezni, például a Kaggle kínálatából. A valós adatokkal való munka segít megérteni az adatminőségi kihívásokat és a modellek korlátait, olyan tapasztalatot nyújtva, amit csupán elméleti tanulással nehéz megszerezni.

– Érdemes naponta időt szánni a kulcsfontosságú könyvtárak kipróbálására, például a matplotlib vizualizációs megoldásaihoz, vagy a TensorFlow és PyTorch használatára a fejlettebb modellezésben.

– Célszerű követni a vezető adat- és analitikai szakemberek kutatásait, blogjait és cikkeit, hogy mindig naprakészek legyünk az iparági áttörésekkel és friss alkalmazásokkal kapcsolatban.

– Vagy ajánlatos részt venni hackathon-okon, adatközpontú meetupokon vagy közösségi projekteken, ahol nemcsak gyakorlati tapasztalatot szerezhetünk, hanem értékes szakmai kapcsolatokra is szert tehetünk.

Sokak által nem gondolt, de annál fontosabb tényező az együttműködés képessége. Azok az adattudományi szakemberek, akik nemcsak a technológiát értik, hanem az adott iparág nyelvezetét és üzleti prioritásait is, gyakran jelentősen felgyorsítják a projektek sikerét. Az erős kommunikációs készségek ugyanolyan értékesek, mint a technikai tudás, hiszen az adatokból született összetett felismeréseket közérthető, meggyőző narratívává kell formálni a döntéshozók számára.

Végső soron az analitikus gondolkodásmód és a modern eszközökben való jártasság kombinációja ritka és keresett előnyt kínál. Azok a szakemberek, akik képesek a számokon túlmutatva az üzleti stratégiát is formálni, nemcsak elemzőként, hanem az innováció irányát meghatározó szereplőként pozícionálják magukat.

A Python ereje az adatmanipulációban

Hogyan kezelhetjük a memória kapacitását meghaladó adathalmazokat?

Előfordul, hogy az adathalmaz akkora, hogy egyszerűen a gép memóriája kevésnek ígérkezik. Ilyenkor jönnek képbe a skálázható megoldások: a Pandas segítségével az adat darabolható, míg a Dask elosztott számítási képessége lehetővé teszi, hogy akár terabájtos mennyiséget is feldolgozz szerényebb hardveren. Ez nem csupán elméleti előny – olyan vállalatok, mint a Netflix vagy az Airbnb, rendszeresen petabájtnyi adatot elemeznek ezekkel az eszközökkel, bizonyítva a technológia valódi hatékonyságát

Hogyan tisztítsuk meg hatékonyan az adatokat?

Szinte mindenki találkozott már olyan adathalmazzal, amely tele van inkonzisztenciákkal vagy hiányzó értékekkel. A jó hír, hogy mindez gyorsan kezelhető: néhány sor kód elegendő ahhoz, hogy interpolációval kitöltsük a hiányokat, Z-pontszám vagy IQR módszerekkel azonosítsuk a kiugró értékeket, majd normalizáljuk az adateloszlást. Ezek a lépések nem csak egyszerű szkriptekben működnek – könnyedén beépíthetők automatizált ETL-folyamatokba, növelve ezzel az adatkezelés megbízhatóságát.

A táblázatok világán túl ma már az idősoros és térinformatikai adatok feldolgozása is sokkal egyszerűbb. A GeoPandas vagy a TimeSeries könyvtárak segítségével a szakemberek minimális kódírással képesek feltárni helyalapú trendeket vagy szezonális mintákat. Ez a sokszínűség tovább erősíti, hogy miért marad nélkülözhetetlen a Python az analitikai szerepkörökben.

Kutatások szerint az elemzőcsapatok több mint 80%-a már napi szinten támaszkodik ezekre az eszközkészletekre az adatok előfeldolgozásánál. Ha tehát az adat-előkészítés túl időigényesnek vagy kaotikusnak tűnik, ezeknek a könyvtáraknak a megismerése nemcsak felgyorsíthatja a munkát, hanem új lehetőségeket is nyithat az adatok mélyebb megértésére. Végső soron így válhatnak a nyers számok átlátható, értelmezhető narratívává.

Python könyvtárak az adatelemzéshez

Ha gyorsan és hatékonyan szeretné kinyerni az adatokból a lényeget, első lépésként érdemes elsajátítani a pandas használatát. Ez a könyvtár az adatelemzés egyik alappillére, amely a PyPI statisztikái szerint havonta már több mint 30 millió letöltést generál. Az intuitív DataFrame struktúra, valamint a rugalmas csoportosítási, szűrési és egyesítési lehetőségek lehetővé teszik, hogy az elemzők percek alatt előkészítsék a legbonyolultabb adathalmazokat is – anélkül, hogy nehézkes SQL lekérdezésekre kellene támaszkodniuk.

A nagyméretű adatok kezelése azonban sokszor többet kíván, mint amit a pandas önmagában kínál. Ilyenkor lép színre a Dask, amely a pandas megszokott szintaxisát ötvözi a párhuzamos számítás erejével. Ennek köszönhetően olyan adathalmazokat is zökkenőmentesen lehet feldolgozni, amelyek meghaladják a memóriakapacitást. Nem véletlen, hogy olyan vállalatok, mint a Capital One, a Daskra támaszkodnak, amellyel akár 70%-kal gyorsabban dolgozzák fel a terabájtos pénzügyi tranzakciós naplóikat – valódi forradalmat hozva a méretgazdaságos adatkezelésben.

A vizualizáció gyakran új betekintéseket nyújt, és ebben a Matplotlib és a Seaborn nyújt nagy segítséget. Míg a Matplotlib részletes irányítást biztosít a diagramok felett, a Seaborn leegyszerűsíti a statisztikai vizualizációkat, könnyedén létrehozva gyönyörű hőtérképeket és kategóriák szerinti diagramokat. Ha interaktív vizualizációra vágyunk, a Plotly lenyűgöző lehetőségeket kínál: interaktív irányítópultjai akár 40%-kal gyorsabb döntéshozatalt tesznek lehetővé olyan cégeknél, mint az Airbnb, a mérnöki blogjuk szerint.

Az utóbbi években a többdimenziós tömbműveletek is forradalmasodtak a NumPy segítségével. Gyors, C-alapú implementációi lehetővé teszik az összetett lineáris algebrai számításokat, amelyek az ajánlórendszerek, tudományos szimulációk és jelfeldolgozási feladatok alapját képezik. A gépi tanulási projektek nagyjából 90%-a a NumPy alapvető funkcióira támaszkodik, alátámasztva e könyvtár kiemelkedő szerepét az adatelemzésben.

Könyvtár

Elsődleges felhasználás

Figyelemre méltó statisztika

Használati példa

pandas

Adatkezelés és előfeldolgozás

Több mint 30 millió letöltés havonta

Pénzügyi adatok tisztítása és előkészítése

Dask

Párhuzamos és elosztott számítástechnika

Feldolgozási idő akár 70%-kal csökkent (Capital One)

Terabájtos pénzügyi naplók kezelése

Matplotlib / Seaborn

Adatvizualizáció

A Seaborn leegyszerűsíti a komplex hőtérképeket

Statisztikai jelentések és kutatási vizualizációk

Plotly

Interaktív diagramok és műszerfalak

Döntéshozatal akár 40%-kal gyorsabb (Airbnb)

Vezetői üzleti irányítópultok

NumPy

Numerikus számítások és tömbműveletek

A gépi tanulási projektek 90%-a NumPy-t használ

Ajánlórendszerek és tudományos szimulációk

Gyakran felmerül a kérdés: melyik eszközt érdemes választani, amikor az adatelemzés bonyolultsága szinte kezelhetetlenné válik? Ahelyett, hogy egyetlen könyvtár mellett köteleznénk el magunkat, érdemes kombinált megközelítést alkalmazni. Például először pandas segítségével tisztíthatjuk és előkészíthetjük az adatokat, majd a Dask párhuzamos számítási képességeivel skálázhatjuk a folyamatokat, végül pedig a Plotly interaktív vizualizációival tekinthetünk rá egy teljes, integrált elemzési láncra.

Ráadásul a Python könyvtárak ökoszisztémája folyamatosan bővül, különleges területek igényei felé. A Statsmodels precíz statisztikai teszteket és idősoros előrejelzéseket kínál, így az ökonometriai elemzések pontossága növekszik. Eközben a SciPy optimalizálási és interpolációs eszközei a mérnöki és tudományos projektek számára nyújtanak nélkülözhetetlen támogatást. Ezeknek az eszközöknek a munkafolyamatba való integrálása segít feltárni azokat a részleteket, amelyeket a hagyományos eszközök könnyen figyelmen kívül hagynak.

Végső soron a megfelelő könyvtárkészlet kiválasztása és elsajátítása nemcsak a termelékenységet gyorsítja fel, hanem az elemzések minőségét is javítja. Hányszor ütköztünk már szűk keresztmetszetekbe, csak mert az eszköztárunk nem volt elég sokoldalú? A megfelelő eszközökkel most már olyan adatkihívásokat is leküzdhetünk, amelyek korábban leküzdhetetlennek tűntek. A hivatalos dokumentációk és a közösségi fórumok folyamatosan frissített, valós példákat és legjobb gyakorlatokat kínálnak, így ezek továbbra is felbecsülhetetlen források maradnak.

A Python valós alkalmazásai az üzleti intelligenciában

Ha a cél egy vállalatnál az, hogy hatalmas adathalmazokat hasznosítható információkká alakítsunk, a Python használata szinte magától értetődő. Olyan cégek, mint a Netflix és a Spotify, a Python segítségével elemzik az ügyfelek viselkedését, akár 85%-os pontossággal előrejelezve az ügyfél-elvándorlást. A pandas és a NumPy könyvtárak gyorsan alakítják a nyers adatokat kezelhető táblázatokká és tömbökké, jóval gyorsabban, mint a hagyományos táblázatkezelők.

A pénzügyi szektorban a Python a csalásfelderítésben is kulcsszerepet játszik: gépi tanulási modellek szűrik át valós időben a több millió tranzakciót, és az anomáliák azonnali azonosítását teszik lehetővé. Például a JPMorgan Chase a téves riasztások 30%-os csökkenéséről számolt be ezeknek a modelleknek a telepítése után, ami közvetlenül növeli a működési hatékonyságot.

Az előrejelző értékesítés területén a kiskereskedelmi óriások automatizált elemzéseket használnak a korábbi beszerzési trendek alapján, lehetővé téve a készletoptimalizálást, amely akár 20%-kal csökkenti a költségeket.

De hogyan integrálják a csapatok ezeket az elemzéseket a meglévő irányítópultokba? Az olyan Python keretrendszerek, mint a Flask és a Dash, lehetővé teszik, hogy az elemzők interaktív BI-irányítópultokat készítsenek a bonyolult front-end fejlesztés nélkül. Ez gyorsítja az átmenetet az adatelemzéstől a vezetői prezentációkig, rövidebb visszacsatolási hurkot biztosítva.

Az adatkapacitások bővítése azonban toborzási kihívásokkal is járhat. Azoknak, akik webes integrációt vagy tartalomkezelést terveznek BI-alkalmazásokhoz, érdemes megfontolni például minősített WordPress-fejlesztők bevonását, hogy áthidalják a technikai elemzés és a felhasználóbarát platformok közötti szakadékot.

És vajon van ennek pénzügyi értelme? Egy McKinsey-jelentés szerint az ilyen, adatalapú munkafolyamatokat alkalmazó szervezetek 15–25%-os bevételnövekedést érhetnek el a jobb döntéshozatal révén. A siker azonban nem csak az eszközökön múlik – a kultúra és az elkötelezettség is kritikus. Az adatértelmezésre és iteratív tesztelésre fókuszáló csapatok gyorsabban érnek el megtérülést. Nem csodaszer ez, hanem egy szilárd, megismételhető módszer, amely a számokat növekedést elősegítő narratívákká alakítja.

A leendő adattudósok számára nélkülözhetetlen készségek

Az adatmanipuláció az adattudományi szerepkörök alapja. A Pandas és a NumPy ismerete ma már alapvető elvárás: ezek az eszközök egyszerűsítik az összetett adatkészlet-transzformációkat és felgyorsítják az elemzést. Már az adattisztítás önmagában is elviheti egy adattudós idejének akár 80%-át, így az automatizált folyamatok jelentős időmegtakarítást eredményezhetnek.

A statisztikai ismeretek gyakran háttérbe szorulnak a kezdők körében, pedig ezek adják a robosztus modellezés alapját. Az eloszlások, a hipotézisvizsgálat és a Bayes-következtetések megértése kulcsfontosságú, ha az elméletet gyakorlati, hasznosítható meglátássá szeretnénk alakítani. A SciPy és a statsmodels használata segít a statisztikai koncepciók gyakorlati alkalmazásában.

A gépi tanulási keretrendszerek – mint a scikit-learn, TensorFlow vagy PyTorch – a legtöbb munkaköri leírásban szerepelnek, de nem elég az API-k ismerete. Tudni kell, mikor melyik algoritmust alkalmazzuk, és hogyan hangoljuk a hiperparamétereket. Az osztályozás, regresszió, klaszterezés és a természetes nyelvi feldolgozás ismerete nyitottá teszi az utat a sokrétű projektek felé.

Az adatvizualizáció az adatokat történetekké alakítja. A Matplotlib, Seaborn és Plotly segítségével olyan mintákat fedezhetünk fel, amelyek a táblázatokban rejtve maradnak. A korai kiugró értékek azonosítása heteket takaríthat meg, és a világos kommunikáció a nem műszaki érdekelt felek felé gyakran megkülönbözteti a kiemelkedő adattudósokat.

Az adatbázis-kezelés továbbra is alap: az SQL a strukturált adatok lekérdezésének közös nyelve, míg a NoSQL (pl. MongoDB) tapasztalat a félig strukturált vagy strukturálatlan adatok kezelésére ad lehetőséget. Az ablakfüggvények, illesztések és a lekérdezések optimalizálásának ismerete felgyorsítja az adatok feltárását.

A felhőalapú számítástechnika ismerete egyre fontosabb. Az AWS, Azure vagy Google Cloud skálázható környezeteket kínál a nagy számítási feladatokhoz. Az automatizált munkafolyamatok és a Docker vagy Kubernetes alapú konténerizáció javítja a reprodukálhatóságot és az együttműködést a csapatokban.

Érdekes rétegszintű készség az olyan tartományspecifikus integráció, mint például a CRM-analitika Visualforce-on keresztül. Ez az összekapcsolódás felbecsülhetetlen értéket ad azon területeken, ahol az analitika felgyorsítja a döntéshozatalt.

Összegzés: elengedhetetlen készségek

- Adatmanipuláció Pandas és NumPy segítségével

- Statisztikai következtetés és hipotézisvizsgálat

- Gépi tanulás és algoritmus-választás (scikit-learn, TensorFlow, PyTorch)

- Fejlett adatvizualizáció Matplotlib, Seaborn és Plotly használatával

- SQL és NoSQL adatbázis-kezelés

- Felhőplatformok ismerete és konténerizáció

- Tartományspecifikus integráció, pl. CRM-analitika Visualforce-on keresztül

A kódolási készségek önmagukban nem elegendőek. A kíváncsiság, az okos kérdések feltevése és a gyors iteráció a legjobb szakemberek mozgatórugója. Egy friss jelentés szerint az adatkutatók 67%-a elismeri, hogy a jó kommunikációs képességek jelentősen növelik a projektek sikerességét. Végső soron a hatékony adattudós nemcsak számokat lát, hanem történeteket mesél, amelyek valódi üzleti értéket teremtenek.

A webfejlesztési keretrendszerek népszerűvé válása

Az elmúlt években a webes alkalmazásokhoz kapcsolódó keretrendszerek jelentős növekedést mutattak. A Flask és a Django vezető szerepet töltenek be: a 2025-ös Stack Overflow fejlesztői felmérés szerint a Django az 5 legkedveltebb háttér-technológiai keretrendszer között szerepel, míg a Flask folyamatosan növekvő népszerűségnek örvend a könnyű, moduláris projektekben. A gyors prototípusgyártás és a skálázható megoldások előtérbe kerülésével ezek az eszközök kulcsfontosságúvá váltak.

Full-stack vagy mikro-keretrendszer?

A választás a projekt hatókörétől és a skálázási igényektől függ. A Django „instant” funkciói – ORM, hitelesítés, adminisztrációs panelek – felgyorsítják az összetett alkalmazások fejlesztését. Ezzel szemben a Flask minimalista, és ideális olyan API-khoz vagy szolgáltatásokhoz, ahol az egyéni komponensek előnyt jelentenek.

Az aszinkron képességek fontossága

A modern alkalmazásoknál az aszinkron működés már nem luxus. A FastAPI, amely a Python aszinkron funkcióira épül, tavaly 34%-os letöltési növekedést ért el a PyPI statisztikái szerint. Az egyszerűség és teljesítmény kombinációja vonzóvá teszi azokat a projekteket, amelyek párhuzamosságot igényelnek bonyolult visszahívások nélkül.

Ökoszisztéma és közösség

A Django kiterjedt bővítménytárával és aktív közösségével biztosítja a zökkenőmentes integrációt és hibaelhárítást. Az újabb keretrendszerek innovációt hoznak, de a dokumentáció hiányosságai és a szélsőséges hibák kezelése kihívást jelenthet. A stabilitás és az újdonság egyensúlya kulcsfontosságú a megfelelő platform kiválasztásánál.

Munkaerőpiaci trendek

A vállalatok egyre inkább előfeltételként jelölik a keretrendszerek ismeretét. A LinkedIn 2025-ös adatai szerint a Django- és Flask-szakértelmet igénylő álláshirdetések száma 27%-kal nőtt 2024-hez képest. Ez az üzleti bizalom jele, hiszen ezek az eszközök felgyorsítják a fejlesztést és csökkentik a hosszú távú karbantartási költségeket.

Gyakorlati tapasztalatok

Sok csapat régi, monolitikus rendszerekről FastAPI-alapú mikroszolgáltatásokra váltott. Az átállás 40%-kal csökkentette a szerverterhelést, és gyorsította a telepítési ciklusokat. A teljesítmény és a fejlesztői élmény összhangja jelentős előnyt biztosít a folyamat minden szakaszában.

Összegzés

A megfelelő keretrendszer kiválasztása a projekt igényeinek, a csapat tapasztalatának és a jövőbeli növekedésnek a függvénye. Gyors piaci belépés vagy hosszú távú bővíthetőség a cél? Ennek megfelelően választhatunk architektúrát, miközben figyelembe vessszük a közösségi támogatást, verziókiadásokat és biztonsági frissítéseket.

Népszerű Python keretrendszerek webfejlesztéshez

Ha a cél a gyors megvalósítás skálázhatóság mellett, a Django továbbra is az egyik legerősebb választás. Az „akkumulátorokkal együtt” filozófiája miatt alapból tartalmaz ORM-et, adminisztrációs felületet, hitelesítést és számos más funkciót. Ez jelentősen csökkenti a külső könyvtárak iránti igényt, és lerövidíti a fejlesztési időt. A 2025-ös Stack Overflow fejlesztői felmérés szerint a Django a Python alapú webes projektek több mint 40%-át működteti, ami jól mutatja a népszerűségét a startupok és a nagyvállalatok körében egyaránt.

Ha viszont a rugalmasság és a könnyű kialakítás a fontos, a Flask ideális alternatíva. Nem kényszeríti ránk az előre gyártott struktúrákat, teljes kontrollt ad, így különösen jól használható kis alkalmazásoknál, mikroszolgáltatásoknál vagy olyan projektekben, ahol a backend tisztán körülhatárolt felelősségekkel működik. Gyakran választják prototípus-készítéshez vagy modern frontend stackek (React, Vue) mellé.

Az aszinkron képességeket natívan támogató FastAPI az utóbbi években robbanásszerűen terjedt. Az ASGI-alapú architektúrájának köszönhetően kiemelkedően gyors, automatikus adatellenőrzést és interaktív API-dokumentációt biztosít. Népszerűsége 2025-ben 70%-kal nőtt, főként a valós idejű alkalmazások és a felhasználók egyre szigorúbb válaszidő-elvárásai miatt.

De mi alapján érdemes választani?

- Django: monolitikus, biztonságos és stabil alap, ideális nagyméretű, komplex alkalmazásokhoz. Gyors fejlesztésű összetett, funkciógazdag appokhoz, sok minden gyárilag meg van oldva.

- Flask és FastAPI: moduláris és rugalmas, ott érdemesebb használni, ahol a testreszabhatóság és a teljesítmény a döntő. Gyors prototípusokhoz vagy könnyű, testre szabható appokhoz, ahol nem kell felesleges „plusz teher”.

A Pyramid szintén említést érdemel: bár kevésbé elterjedt, a „kicsiben kezd, nagyban skáláz” filozófiája és magas konfigurálhatósága azoknak előnyös, akik egyensúlyt keresnek a Django összetettsége és a Flask minimalizmusa között.

Bármit is választunk, a modern telepítési eszközök – mint a Docker és a Kubernetes – integrációja kulcsfontosságú. Ezek biztosítják a gyors piacra lépést és a zökkenőmentes átállást a helyi fejlesztésről a felhőalapú környezetbe.

Tanulási javaslat: érdemes először a Django ökoszisztémáját elsajátítani, mert széles körben alkalmazható és biztos alapokat ad. Ezután érdemes kiegészítésként a Flask-et és a FastAPI-t felfedezni, ha a rugalmasság vagy a teljesítmény kerül előtérbe.

Django és Flask összehasonlítása

A Django akkor jó választás, ha a projektünk nagyobb, összetettebb, és szükségünk van azonnal használható alapokra. Ez a keretrendszer tartalmaz mindent: adatbázis-kezelést (ORM), felhasználói hitelesítést, admin felületet és biztonsági megoldásokat. Így nem nekünk kell mindent nulláról felépíteni. Emiatt ideális, ha gyorsan szeretnénk skálázni, vagy bonyolult adatbázis-műveleteket kell kezelnünk. Példa: az Instagram is Django-val indult, és már a kezdetektől több millió felhasználót bírt el.

A Flask ezzel szemben sokkal könnyedebb és rugalmasabb. Akkor előnyös, ha kisebb alkalmazást, API-t vagy mikroszolgáltatást készítünk, és szeretnnk mi magunk eldönteni, milyen kiegészítőket használunk. Nem kényszeríti ránk a fix struktúrát, hanem mi szabjuk meg az architektúrát. Emiatt ideális MVP-khez (első működő verziókhoz) vagy kísérletekhez, ahol a gyors indulás számít.

Teljesítmény

Kisebb, egyszerű alkalmazásoknál a Flask általában gyorsabb, mert kevés erőforrást igényel. Nagyobb forgalomnál viszont a Django jobban bírja a terhelést: beépített gyorsítótár, ORM és köztes rétegek segítik a hatékony működést. A Flasknál a skálázás több kézi hangolást igényel.

Tanulási görbe

A Flask könnyen tanulható, főleg kezdőknek – a dokumentációja egyszerű, és gyorsan elsajátíthatók az alapok. A Django tanulása több időt vesz igénybe, mert meg kell érteni a szabályait és struktúráját. Ez a befektetés azonban hosszú távon megtérül: könnyebb lesz karbantartani és biztonságosabb lesz az alkalmazás.

Csapatméret és munkastílus

A Flask könnyen tanulható, főleg kezdőknek – a dokumentációja egyszerű, és gyorsan elsajátíthatók az alapok. A Django tanulása több időt vesz igénybe, mert meg kell érteni a szabályait és struktúráját. Ez a befektetés azonban hosszú távon megtérül: könnyebb lesz karbantartani és biztonságosabb lesz az alkalmazás.

- Vegyes tapasztalatú vagy szoros határidőkkel dolgozó csapatok → a Django következetességet ad, kevesebb vita az architektúráról.

- Kisebb csapatok vagy egyéni fejlesztők → a Flask nagyobb szabadságot nyújt, mindenki maga döntheti el, mikor és hogyan épít be funkciókat.

Közösségi támogatás

- Django: nagyobb közösség, vállalati támogatás, sok éles környezetben bevált bővítmény.

- Flask: folyamatosan bővülő kiterjesztések, de a megfelelő modulok összeválogatása inkább a fejlesztő felelőssége.

- Dokumentáció: a Django részletes, lépésről lépésre vezet; a Flask inkább kísérletezésre és kreativitásra ösztönöz.

Összegzés

- Django → stabil, biztonságos, funkciógazdag alap nagyobb rendszerekhez, közösségi platformokhoz vagy vállalati alkalmazásokhoz.

- Flask → könnyű, rugalmas és minimalista megoldás API-khoz, prototípusokhoz vagy testreszabott kisebb alkalmazásokhoz.

A Django hivatalos oldala, itt megtalálod a dokumentációt is.

Ajánlott gyakorlatok skálázható webalkalmazásokhoz

1. Moduláris felépítés

Már a tervezésnél érdemes kisebb, önálló egységekre (szolgáltatásokra, komponensekre) bontani az alkalmazást. Ez a mikroszolgáltatás-architektúra lényege:

- gyorsabb frissítések,

- könnyebb skálázás csak azokra a részekre, ahol tényleg szükséges.

👉 Példa: a Netflix több mint 200 millió fiókot kezel ezzel a módszerrel, folyamatos leállások nélkül.

2. Aszinkron feldolgozás

Érdemes elkerülni, hogy minden feladat a fő felhasználói szálon fusson. A CPU-igényes műveleteket érdemes háttérfolyamatokba szervezni üzenetsorokkal, például RabbitMQ-val vagy Kafkával. Ez:

- csökkenti a válaszidőt,

- megelőzi a kérések torlódását.

👉 Példa: a LinkedIn 30%-kal gyorsabb válaszidőt ért el, miután átállt aszinkron munkafolyamatokra.

3. Adatbázis kiválasztása

- Monolitikus relációs adatbázis helyett érdemes NoSQL-megoldásokat is megfontolni.

- Dokumentumtárolók, mint a MongoDB, jól kezelik a strukturálatlan adatokat és a horizontális skálázást.

👉 Példa: az Instagram a Cassandrára váltott a nagy írási terhelés miatt, így az adatnövekedést a sebesség feláldozása nélkül kezeli.

4. Automatikus skálázás

Konténer-alapú platformok, például a Kubernetes, valós idejű metrikák alapján irányítják az erőforrásokat és állítják be a podokat, így:

- csökken az erőforráspazarlás,

- megbízható marad az alkalmazás csúcsforgalom esetén is.

5. Gyorsítótárazás

A gyorsítótár bevezetése megéri a plusz bonyolultságot:

- Böngészőszintű és elosztott gyorsítótárak (pl. Redis) csökkentik a háttérszolgáltatások terhelését.

- Javítják a felhasználói élményt.

👉 Példa: az Etsy oldalbetöltési ideje 25%-kal javult agresszív gyorsítótárazás és cache-érvénytelenítés révén.

4. Biztonság

- Alkalmazzunk sebességkorlátozást és API-átjárókat a visszaélések ellen.

- Védjük a végpontokat, mert a támadások könnyen alááshatják az alkalmazás teljesítményét és a cég hírnevét.

5. Naplózás és monitorozás

- A kód minősége mellett a logolás és a teljesítményfigyelés ugyanolyan fontos.

- Eszközök, mint a Prometheus és a Grafana, segítenek a valós idejű adatok elemzésében.

👉 Példa: egy fintech startup memóriaszivárgások korai felismerésével több ezer dollárt takarított meg a leállások és ügyfélelvándorlás elkerülésével.

6. Automatizált integráció és telepítés

- Manuális kiadások lassítják az innovációt és növelik a hibák esélyét.

- A CI/CD folyamatok (folyamatos integráció és telepítés) gyorsítják az iterációkat, növelik a megbízhatóságot, és elengedhetetlenek, ha több százezer felhasználó támaszkodik a platformunkra.

Python integrációja modern front-end technológiákkal

A háttérben futó Python-alkalmazások és az interaktív felhasználói felületek összekapcsolása jelentős előnyöket kínál a modern webfejlesztésben. A Django például kiválóan együttműködik olyan front-end könyvtárakkal, mint a React vagy a Vue.js. Ez a kombináció lehetővé teszi zökkenőmentes API-k létrehozását, amelyeket a front-end könnyen használhat, így a felhasználók számára gördülékeny és reszponzív élményt biztosít. A Django REST keretrendszer segítségével a végpontok egyszerűen közzétehetők, így a React komponensek aszinkron módon kérhetnek le adatokat, csökkentve a késleltetést és javítva a válaszidőt.

Az élő adatok és valós idejű frissítések kezelése szintén kulcsfontosságú. A Django Channels könyvtár WebSocket-támogatása lehetővé teszi az élő adatfolyamok kezelését, ami különösen hasznos csevegőalkalmazásoknál vagy értesítési rendszereknél. Ezek az élő adatcsatornák könnyen integrálhatók front-end állapotkezelő könyvtárakkal, mint a Redux vagy a Vuex, biztosítva az alkalmazás összetevőinek szinkronizálását és a felhasználói élmény konzisztenciáját.

Az adatcsere szabványai sem elhanyagolhatók. A JSON továbbra is a Python-alapú szerverek és a JavaScript-alapú front-endek közös nyelve, amely lehetővé teszi a strukturált adatok megbízható átvitelét. Az olyan eszközök, mint a Pydantic vagy a Marshmallow, a beérkező adatok validálásával és szerializálásával biztosítják az adatok integritását, megakadályozva a hibákat, amelyek helytelenül formázott kérésekből eredhetnek. A strukturált és ellenőrzött adatok nemcsak a hibakeresést könnyítik meg, hanem felgyorsítják az új funkciók bevezetését, így az alkalmazás gyorsan és stabilan reagálhat a felhasználói igényekre.

Példa a közösségi média integrációjára

Egy gyakorlati példa a közösségi média integrációjára a külső API-kkal, például a Twitter API-val való munka. A Python backend rendszerbe épített megbízható Twitter API-kulcs lehetővé teszi a szükséges végpontok biztonságos elérését. A front-end alkalmazások ezután a belső API-kat hívják meg, amelyek kezelik a hitelesítést és az adatok gyorsítótárazását. Ez a minta egyszerre javítja a rendszer teljesítményét és biztosítja a biztonságot, miközben a felhasználói élmény zökkenőmentes marad.

A biztonság kezelése külön figyelmet igényel. Meg kell érteni, hogy a gyakran előforduló támadási minták és visszaélések milyen gyenge pontokra építenek. Ennek ismeretében a robusztus validációs és hitelesítési mechanizmusok elengedhetetlenek, amelyek biztosítják, hogy a háttérlogika és a front-end kérései megfelelően szinkronizálódjanak. Az OAuth-folyamatok vagy a token-alapú hitelesítés alkalmazása garantálja, hogy a felhasználók érzékeny adatai védve maradjanak, különösen akkor, ha harmadik féltől származó szolgáltatásokat integrálunk.

A telepítés és a skálázhatóság szempontjából a Dockerrel történő konténerizáció leegyszerűsíti a fejlesztés és az éles környezet közötti átmenetet, minimalizálva a „nálam működik” típusú problémákat. A Kubernetes segítségével ezek a konténerek hatékonyan skálázhatók, lehetővé téve, hogy a front-end keretrendszerek több back-end példánnyal is zavartalanul kommunikáljanak. Így a mikroszolgáltatás-alapú architektúra nemcsak rugalmas és biztonságos, hanem a növekvő felhasználói igényekhez is zökkenőmentesen alkalmazkodik.

Technológia

Szerep

Előny / Haszon

Django REST Framework

API fejlesztés

Strukturált és tiszta REST végpontok kialakítása

React / Vue.js

Felhasználói felület

Reszponzív és interaktív kezelőfelületek létrehozása

Django Channels

WebSocket-támogatás

Valós idejű adatátvitel és kommunikáció biztosítása

Pydantic / Marshmallow

Adatérvényesítés

Megakadályozza a helytelenül formázott adatokból eredő hibákat

OAuth / Token alapú hitelesítés

Biztonsági réteg

Érzékeny adatok és műveletek védelme, biztonságos felhasználói hozzáférés

Docker / Kubernetes

Telepítés és skálázás

Megbízható, skálázható és egységes környezet biztosítása fejlesztéstől élesig

A legfrissebb iparági jelentések szerint azok az alkalmazások, amelyek Python backendet modern frontend keretrendszerekkel kombinálnak, akár 30%-kal gyorsabb fejlesztési ciklusokat érnek el. Ez a megnövekedett sebesség felgyorsítja a visszacsatolási folyamatokat, ami kritikus a gyors tempójú fejlesztési modellekben. A tapasztalatok alapján ezen technológiák integrálása ma már nem csupán választási lehetőség, hanem stratégiai döntés a projektek sikerességének növelése és a felhasználói elégedettség maximalizálása érdekében.

A telepítés és karbantartás megértése Python projektekben

A Python-projektek telepítésének és karbantartásának megértése kulcsfontosságú a megbízható és skálázható rendszerek kialakításához. Az automatizált telepítési folyamatok bevezetése – CI/CD eszközökkel, mint a Jenkins, GitHub Actions vagy GitLab CI – minimalizálja a manuális hibák lehetőségét és felgyorsítja a kiadásokat. A 2025-ös Stack Overflow fejlesztői felmérés szerint az automatizált telepítést alkalmazó csapatok akár 40%-kal is lerövidíthetik a kiadási időt, miközben 30%-kal kevesebb kiadás utáni hibával találkoznak.

A Dockerrel történő konténerizáció biztosítja a fejlesztési, tesztelési és éles környezetek konzisztenciáját, így csökkentve a „saját gépemen működik” jellegű problémákat, és egyszerűsítve a visszagörgetést. A Kubernetes vagy más orkestrációs eszközök pedig nagyobb alkalmazások esetén segítik a skálázást és a magas rendelkezésre állás fenntartását.

A karbantartás hatékony kezelése érdekében a folyamatos monitorozás elengedhetetlen. Eszközök, mint a Prometheus vagy a New Relic, valós idejű mutatókkal – például CPU-terhelés, válaszidő vagy hibaszázalék – segítenek azonnal észlelni a teljesítményromlást vagy anomáliákat. Az előre konfigurált riasztások lehetővé teszik a proaktív beavatkozást, megelőzve a leállásokat.

A verziókövetés túlmutat a kódon: az adatbázis-migrációk kezelését olyan eszközökkel, mint az Alembic vagy a Flyway, összehangba hozhatjuk az alkalmazásfrissítésekkel, elkerülve a szinkronizációs problémákat. A funkcióváltások bevezetése FeatureFlags vagy Unleash segítségével rugalmasságot biztosít a csapatok számára a funkciók engedélyezéséhez vagy letiltásához anélkül, hogy új telepítésekre lenne szükség.

A biztonsági frissítések és a függőségek rendszeres karbantartása kritikus. A Snyk jelentése szerint a biztonsági incidensek 60%-a elavult könyvtárakra vezethető vissza. A folyamatokba épített biztonsági vizsgálatok és a rendszeres függőségi felülvizsgálatok jelentősen csökkentik ezt a kockázatot.

A konfigurációk központosítása, például Ansible vagy Terraform használatával, biztosítja az eltérések elkerülését és a környezetek zökkenőmentes helyreállítását több szerveren. Az infrastruktúra kódként való alkalmazása reprodukálható, következetes környezeteket biztosít, míg naplózási keretrendszerek, mint a Loguru, vagy a beépített naplózás részletes eseményrögzítést tesz lehetővé a hibaelhárításhoz.

A telepítési lépések világos dokumentálása, még automatizált folyamatok esetén is, az intézményi tudás megőrzését szolgálja. A vállalati tapasztalatok azt mutatják, hogy az átlátható visszagörgetési tervek a gyorsított kiadásokkal kombinálva minimalizálják a felhasználókra gyakorolt hatást. Egyetlen kihagyott telepítési ciklus vagy hibás frissítés kaszkádos leállást okozhat, amit egyszerű, jól bevált gyakorlatokkal elkerülhetünk.

Végső soron a telepítési és karbantartási taktikákat a projekt összetettségéhez és a csapat méretéhez kell igazítani. Ami egy startup számára ideális, az a vállalati működést akár megbéníthatja, és fordítva. A kihívás abban rejlik, hogy az automatizálást, a megfigyelhetőséget és az emberi felügyeletet egyensúlyban tartsuk, így biztosítva a megbízhatóságot túlzott mérnöki munka nélkül.

A teljes cikk elérhető itt az eredeti nyelven írt forrásból.

Mészáros Csaba

Alapító · Python Project

„Pythonban gondolkodni – lépésről lépésre.”

💡 Itt tart a Python piac ma — és hova léphetsz tovább?

A Python iránti kereslet nem véletlen: a nyelv sokoldalúsága, egyszerűsége és széles eszköztára olyan technológiai trendekhez kapcsolja, mint az automatizálás, AI, adatfeldolgozás és backend fejlesztés — amelyek ma és holnap is meghatározzák a karrierlehetőségeket.

A Python Start tréning nem egy „csak alapok” kurzus — hanem az a strukturált belépő út, amelynek segítségével:

✓ stabilan értheted meg a Python alapjait és logikáját,

✓ megszerezed a gondolkodási rutint, ami később adatelemzésben, automatizálásban vagy webes fejlesztésben is alapot adhat.

👉 Ez nem AI-specifikus vagy adatelemző tréning, hanem a keret, amin belül később speciálisabb irányokban tudsz fejlődni — ha tovább lépsz.

Videók + feladatok + megoldások + garancia:

Kezdőknek – rövid leckék, mini feladatok e-mailben: